[16:48 Thu,6.October 2022 by Thomas Richter] |

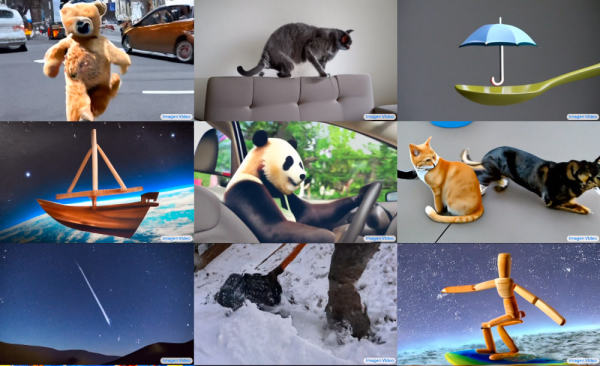

Nachdem gerade Meta seine  Google Imagen Video Imagen Video kann - ganz analog zu den Bildgenerierungs KIs wie etwa Stable Diffusion, DALL-E 2 und Imagen - durch eine Kette von Diffusion Modellen nur anhand einer kurzen Textbeschreibung beliebige Objekte in einem beliebigen Bildstil erzeugen und diese sinnvoll animieren. Wie schon diese "versteht" auch Imagen Video Räumlichkeit und kann so Kamerafahrten durch dreidimensionale Räume produzieren, physikalisch korrekt die Beleuchtung von Szenen ändern (inklusive de Schattenwurfs) oder Objekte umkreisen oder diese rotieren. Drone flythrough a tropical jungle covered in snow Imagen Video erzeugt hochauflösende Videos durch eine Reihe kaskadierender Diffusionsmodelle. In einem ersten Schritt wird eine Eingabeaufforderung kodiert, dann generiert ein Basis-Video-Diffusionsmodell ein Video aus 16 Einzelbildern mit einer Auflösung von 24×48 Pixeln und 3 Bildern pro Sekunde; darauf folgen mehrere Modelle für temporale Super-Resolution (TSR) und räumliche Super-Resolution (SSR), um ein Upsampling durchzuführen und ein endgültiges 128-Bilder-Video mit einer Auflösung von 1280×768 und 24 Bildern pro Sekunde zu generieren - das Ergebnis ist dann ein 5.3 Sekunden langes hochauflösendes Video. Die folgenden Beispielen (auf der A Astronaut riding a horse A cat eating food in a bowl in style of van Gogh a drone flying through the interior of Sagrada Familia cathedral a bunch of colorful candies falling into a try in the shape of "Imagen Video" smooth videol teddy bear iceskating on times square a drone flying through the interior of Sagrada Familia cathedral Google PhenakiGoogles  Thus Phenaki can generate not only small animation clips, but (in the example over 2 minutes) long plan sequences , in which by camera movement or morphings from scene to scene is changed. The user thus becomes the director and scriptwriter of his own generated film. Phenaki gives despite the still low picture quality so actually best a view of the future of the films produced by users in interaction with text-2-video AIs.  A 30-second video (128x128 pixels with 8 fps) is generated in just 22 seconds, i.e. it is generated faster than it can be viewed (with better hardware in the future, of course, also in a higher resolution and frame rate). In this way, an individual film could be generated in real time while watching and thus react to user feedback, for example. Unfortunately, Google has not yet published any source code for both algorithms - officially this is due to the fear that violent or pornographic content will be generated with Google algorithms - but work is being done on appropriate filters. deutsche Version dieser Seite: Text-zu-Video KI jetzt auch von Google: Imagen Video |